关于交叉熵在loss函数中使用的理解

信息论

交叉熵是信息论中的一个概念,想要了解交叉熵的本质,需要从最基本的概念讲起。

1. 信息量

首先是信息量。假设我们听到了两件事,分别如下:

事件A:巴西队进入了2018世界杯决赛圈。

事件B:中国队进入了2018世界杯决赛圈。

仅凭直觉来说,显而易见事件B的信息量比事件A的信息量要大。究其原因,是因为事件A发生的概率很大,事件B发生的概率很小。所以当越不可能的事件发生了,我们获取到的信息量就越大。越可能发生的事件发生了,我们获取到的信息量就越小。那么信息量应该和事件发生的概率有关。

假设是一个离散型随机变量,其取值集合为,概率分布函数,则定义事件的信息量为:

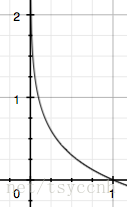

由于是概率所以的取值范围是[0, 1],绘制为图形如下:

2. 熵

考虑另一个问题,对于某个事件,有nn种可能性,每一种可能性都有一个概率这样就可以计算出某一种可能性的信息量。举一个例子,假设你拿出了你的电脑,按下开关,会有三种可能性,下表列出了每一种可能的概率及其对应的信息量

| 序号 | 事件 | 概率p | 信息量I |

|---|---|---|---|

| A | 电脑正常开机 | 0.7 | -log(p(A))=0.36 |

| B | 电脑无法开机 | 0.2 | -log(p(B))=1.61 |

| C | 电脑爆炸了 | 0.1 | -log(p©)=2.30 |

注:文中的对数均为自然对数

我们现在有了信息量的定义,而熵用来表示所有信息量的期望,即:

其中n代表所有的n种可能性,所以上面的问题的结果就是

然而,有一类比较太特殊的问题,比如,投掷硬币只有两种可能,字朝上或花朝上。买彩票只有两种可能,中奖或不中奖。我们称之为0-1分布(二项分布的特例),对于这类问题,熵的计算方法可以简化为如下算式:

3. 相对熵

相对熵又称KL散度,如果我们对于同一个随机变量x有两个单独的概率分布P(x)或Q(x),我们可以使用KL散度来衡量这两个分布的差异。

即如果用P来描述目标问题,而不是用Q来描述目标问题,得到的信息增量。

在机器学习中,P往往用来表示样本的真实分布,比如[1,0,0]表示当前样本属于第一类。Q用来表示模型所预测的分布,比如[0.7,0.2,0.1]

直观的理解就是如果用P来描述样本,那么就非常完美。而用Q来描述样本,虽然可以大致描述,但是不是那么的完美,信息量不足,需要额外的一些“信息增量”才能达到和P一样完美的描述。如果我们的Q通过反复训练,也能完美的描述样本,那么就不再需要额外的“信息增量”,Q等价于P。

KL散度的计算公式:

n为事件的所有可能性。

的值越小,表示q分布和p分布越接近

4. 交叉熵

对于KL散度的公式进行变形可以得到:

等式的前一部分恰巧就是p的熵,等式的后一部分,就是交叉熵

在机器学习中,我们需要评估label和predicts之间的差距,使用KL散度刚刚好,即,由于KL散度中的前一部分不变,故在优化过程中,只需要关注交叉熵就可以了。所以,一般在机器学习中直接使用交叉熵做loss,评估模型。

参考:https://blog.csdn.net/tsyccnh/article/details/79163834?tdsourcetag=s_pctim_aiomsg